Quando si parla di Home Theater o meglio Home Theatre, il pensiero corre automaticamente a faraoniche sale dedicate, grandi schermi, impianti sonori con decine di speaker; Tuttavia, per comprendere l’evoluzione di quello che è oggi diventato un intero segmento di mercato, è necessario fare un salto indietro di 50 anni.

Se i cinefili degli anni ’70 avessero potuto viaggiare nel tempo fino ai nostri giorni, probabilmente sarebbero rimasti esterrefatti nell’ammirare la qualità disponibile nei cinema odierni, così come negli Home Theatre e nelle Media Room; perfino un filmato per smartphone possiede una risoluzione e un dettaglio inimmaginabile per quell’epoca. Ma non è stato semplice: la strada che ci ha portato alle meraviglie tecnologiche di oggigiorno ha richiesto una serie enorme di piccole e grandi innovazioni -e soprattutto nuove idee- che, sedimentandosi su quelle esistenti, hanno prodotto i risultati che vediamo oggi, in qualche caso superiori perfino all’esperienza cinematografica.

A quei tempi, il suono al cinema era rigorosamente mono. Dolby® Stereo fu introdotto nel 1975 e ebbe la sua vera svolta con l’uscita di Star Wars nel 1977. Nello spazio assegnato per la traccia mono convenzionale c’erano due colonne sonore che potevano trasportare non solo le informazioni del canale sinistro e destro, ma anche -mediante un processo di codifica cosiddetta a matrice- un terzo canale dello schermo centrale, oltre a un quarto canale surround per il suono ambientale e gli effetti speciali.

A cavallo degli anni ’70 e ’80 non era raro ammirare la tag line “70mm e Dolby Stereo a 6 tracce” incastonata sui poster e pubblicità sui giornali per pubblicizzare film ad alto e altissimo budget. Al tempo, quella era l’esperienza cinematografica più all’avanguardia che si potesse vivere: era pura fantascienza.

I Primordi dell’Home Theatre (anni’80)

Quando Bill Crutchfield ha fondato l’omonima società statunitense nel 1974, per lungo tempo si è concentrato sulla semplice rivendita delle autoradio. Poi, pian piano, ha aggiunto novità al catalogo: nel 1981, ad esempio, c’erano ancora sistemi audio da incasso e dispositivi portatili, ma nel giro d’un paio d’anni, lo scenario dell’elettronica di consumo è mutato in modo drastico con l’introduzione di videoregistratori e tv stereo, ed è in quel momento che si intravedono le radici del fenomeno dell’Home Theatre.

Tuttavia è solo nel 1983 che i cataloghi di elettronica hanno iniziato a proporre prodotti simili per concetto alle apparecchiature dei nostri giorni; la Crutchfield, pioniera dell’epoca, lanciò proprio in quell’anno il “Centro di Piacere” che oggigiorno, come brand appare un po’ infelice. Ma l’idea era ottima perché includeva “una TV a colori e ad alta risoluzione da 19 pollici, un videoregistratore stereo, un lettore di video disc stereo, un ricevitore AM/FM stereo e un mangianastri.” Il tutto acquistabile separatamente o in un modulo integrato e ottimizzato per funzionare assieme, al costo di 3.400$ ovvero circa 7.000€ odierne. È praticamente l’antesignano dei moderni impianti di Home Theatre.

Certo, oggi con la stessa cifra ci si porta a casa molto di più e molto di meglio. TV LCD o OLED che superano i 100″, schermi con risoluzioni 4K e 8K, proiettori digitali 4K e ricevitore AV capaci di gestire decine di speaker contemporaneamente e subwoofer, con effetti volumetrici e spaziali.

Si tratta di tecnologie che rivaleggiano e in molti casi superano -ad esclusione della grandezza della sala- le feature offerte dalla maggior parte dei cinema. Ma negli anni ’80 era tutta un’altra storia, e per vedere cambiamenti significativi bisogna attendere la fine degli anni ’90, quando si è verificato un improvviso balzo in avanti.

Evoluzione dell’Audio (Anni ’80-’90)

Sulla carta, il Dolby® Surround è stato introdotto nei cinema a metà degli anni 70 ma in effetti ci ha messo oltre 10 anni a diventare una tecnologia fattibile anche per l’Home Theatre. L’introduzione dei videoregistratori HiFi, che lavoravano sul completo set di frequenze 20-20.000 Hz ha consentito di fare il grande salto e abbandonare il mono, che invece era vincolato agli stringenti 70-10.000 Hz.

Nel 1987, per intenderci, i ricevitori A/V col supporto a Dolby Surround integrato esistevano eccome, ma si contavano letteralmente sulla punta dell dita. C’erano anche processori Dolby venduti separatamente che si potevano aggiungere alle configurazioni esistenti per creare il suono surround, ma si trattava di merce rara, costosa e da apripista.

Il Dolby Surround, in quell’epoca, aveva solo 4 canali: i frontali destro e sinistro, un canale centrale per i dialoghi e infine un canale surround splittato e inviato ad un paio di casse usate specificatamente per lo scopo. Funzionava e rendeva l’idea, ma somigliava quasi un vorrei-ma-non-posso.

Sempre in quell’anno, Dolby lanciò il Pro Logic che -in luogo d’un sistema completamente diverso- introduceva un metodo migliorato per il processamento delle tracce Dolby Surround. Modulando la cosiddetta “logica di direzionamento del ricevitore Surround” permetteva di alzare o abbassare il volume di ogni canale in modo indipendente, il che a sua volta consentiva di fornire un più preciso piazzamento spaziale di dialoghi, musica e effetti sonori.

La Rivoluzione Dolby Digital (anni ’90)

Nonostante un brand che evoca tecnologie superiori, Dolby Surround e Dolby Pro Logic si basavano su audio analogico; l’idea era di spremere quattro canali sonori in due, per poi scompattarli al momento della riproduzione attraverso il processore audio.

Il passaggio al digitale avvenne solo col Dolby Digital, lanciato ufficialmente nel 1991; questo protocollo utilizza l’audio digitale per creare un suono surround su sei canali separati: fronte destro, fronte sinistro, centrale, surround indipendenti dentro e sinistro, oltre un canale LFE (a basse frequenze) da convogliare ad un subwoofer.

La separazione dei canali, il rapporto segnale rumore molto più favorevole e l’estrema precisione del piazzamento spaziale degli effetti sonori lo rendevano un sistema capace di fare tutta la differenza del mondo, quanto a qualità audio complessiva.

Il primo film a implementarlo fu Batman – Il Ritorno, nel 1992. E sebbene tecnicamente le tracce Dolby Digital erano già approdate negli Home Theatre attraverso laserdisc -il primo standard di videoregistrazione su disco ottico creato nel 1978- fu solo col lancio del DVD nel 1997 che il formato prese davvero piede.

Dolby Digital infatti costituiva il formato audio standard per i DVD. I primi componenti compatibili con Dolby Digital erano processori a sé stanti da connettere ai ricevitori AV esistenti; ma non ci volle molto perché sul mercato approdassero ben presto ricevitori con Dolby Digital integrato.

Rivoluzione DVD

L’evento che ha cambiato tutto nel mondo dell’Home Theatre è avvenuto nel 1997, con l’introduzione dei DVD. Una tecnologia capace di veicolare un flusso video di qualità nettamente superiore (720 x 480 pixel, il doppio del VHS) e soprattutto un eccellente audio 5.1 Dolby® Digital e/o DTS.

Un singolo disco DVD poteva ospitare fino a 2 ore di video e questo è niente; il vero effetto collaterale dei supporti ottici era un altro: non era necessario riavvolgere il nastro alla fine.

Per arrivare a DVD-Audio e SACD (Super Audio CD) ci sono voluti solo due anni, e sebbene tecnicamente la maggior parte di questi dischi fossero stereo (soprattutto all’inizio), si tratta dei primi veri tentativi di portare la quadrifonia e la musica multicanale surround nelle case.

Il DVD-Audio è morto poco dopo, ma SACD è ancora disponibile oggi, pur se per una ristretta comunità di audiofili.

HD DVD e Blu-ray

L’ultimo salto evolutivo, prima dei servizi di streaming dei nostri tempi, è avvenuto qualche anno fa, nel 2006, quando si sono fronteggiati sul mercato due diversi standard di dischi ad alta risoluzione: da una parte c’era HD DVD, messo a punto da un consorzio di produttori hardware e software capeggiati da Toshiba e Warner Media; dall’altra invece c’era il Blu-ray Disc di Sony.

Entrambi i formati potevano contenere molti più dati di un DVD tradizionale, grazie allo sviluppo di una tecnologia simile e parallela. In luogo del laser rosso, si usava un raggio blu capace di leggere punti molto più piccoli sulla superficie del disco. Questa trovata ha permesso di raggiungere la pietra miliare del full HD 1080p con l’audio lossless grazie del Dolby® TrueHD e del DTS-HD Master Audio.

Ad oggi, solo il Blu-Ray è ancora tra noi, mentre l’HD DVD fu mandato ufficialmente in pensione nel 2008.

Uno dei problemi introdotti coi lettori di nuova generazione, tuttavia, era come convogliare un flusso di dati tanto grande alla tv o al ricevitore, senza perdere in qualità; coi cavi analogici, infatti, era semplicemente impossibile. Ecco perché fu sviluppato HDMI, in uso ancora oggi nelle sue versioni più aggiornate.

Introdotto nel 2002, questo tipo di connessione completamente digitale era in grado di trasportare il segnale audio e video dei dischi ottici, nel pieno rispetto del copyright e con un singolo cavo. L’ultima versione, la 2.1, è progettata per gestire gli 8K.

L’Evoluzione di TV & Proiettori HD

In generale, è possibile affermare che TV e proiettori non abbiano seguito il passo dell’intrattenimento digitale ad alta definizione; tuttavia, negli gli ultimi 20 anni si è vista una importante trasformazione anche in ambito domestico.

Fino alla fine degli anni ’90, i televisori erano tutti basati su tecnologia CRT, cioè il vecchio tubo catodico. I CRT erano in grado di produrre buone immagini ad alta definizione -per il tempo- ma la tecnologia necessaria per gestire gli schermi più ampi era costosa, e comunque parliamo di dimensioni del pannello parecchio inferiori rispetto a ciò che oggi consideriamo la norma. Inoltre, i sistemi CRT erano grossi, pesanti e richiedevano una costante manutenzione.

Nel 2000 hanno iniziato a fare capolino sul mercato tv a schermo piatto molto sottili basate su tecnologia al plasma o LCD che, ameno per i primi tempi, venivano vendute nei negozi fianco a fianco ai vecchi CRT. In qualunque grande negozio d’elettronica era facile trovare contemporaneamente:

- TV a Tubo Catodico: Prezzi molto bassi, ma risoluzione verticale di appena 330 linee.

- E-DTV: Prezzi aggressivi, risoluzione lievemente migliore di 480p.

- TV HD-Ready: Più costose, ma meno care delle HDTV, supportavano le risoluzioni 720p e/o 1080i (spesso non proprio con la qualità che ci si aspettava), tuttavia non integravano un ricevitore HD.

- TV HD: Costavano parecchio ma supportavano perfettamente i720p e i 1080i, e in più disponevano di un decoder HD integrato per ricevere le trasmissioni in alta risoluzione.

Le tv piatte di quegli anni avevano ancora una risoluzione dello schermo di 720p o 1080i con sintonizzatore incorporato per trasmissioni HD over-the-air; la transizione dai vetusti 4:3 al formato widescreen 16:9 era in atto, e per qualche anno i due sistemi hanno dovuto coesistere. Tant’è che uno il connettore più diffuso, anche sulle TV HD da migliaia di Euro, continuava ad essere analogico; qualche produttore lo affiancava al DVI, utilizzato anche sui monitor per computer, ma è durata poco: HDMI infatti era dietro l’angolo.

E sebbene le TV a retro-proiezione si contendessero il primato di migliore qualità visiva coi modelli basati su Plasma e LCD, erano pure molto più voluminosi; e ben presto finirono per lasciare il posto alle tecnologie concorrenti, più sottile e gradevoli a livello estetico.

A questo punto dell’evoluzione, il metro di paragone con cui si misurava le prestazioni di una tv erano il full HD 1080p; ed è proprio allora che i proiettori hanno iniziato a diventare sempre più popolari. Con l’abbraccio del digitale, si sono fatti più economici e soprattutto meno complicati da gestire e manutenere.

Per arrivare a una visione domestica che ricalca da vicino quella cinematografica, tuttavia, bisogna attendere l’arrivo dell’HDTV e lo spegnimento spegnimento totale della storica televisione analogica terrestre, avvenuto il 4 luglio 2012. Un passaggio che, assieme alla diffusione dei dischi Blu-ray ad alta definizione, ha innescato la serie di eventi che ci ha portato all’età dell’Home Theatre come lo conosciamo.

L’era dei 4K

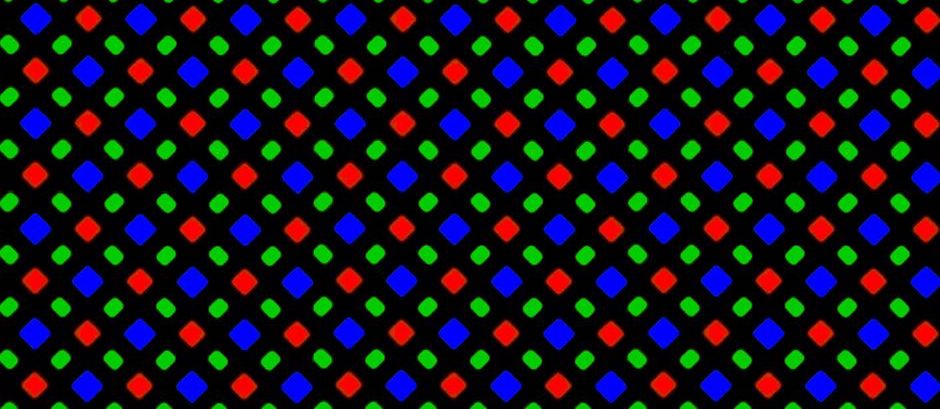

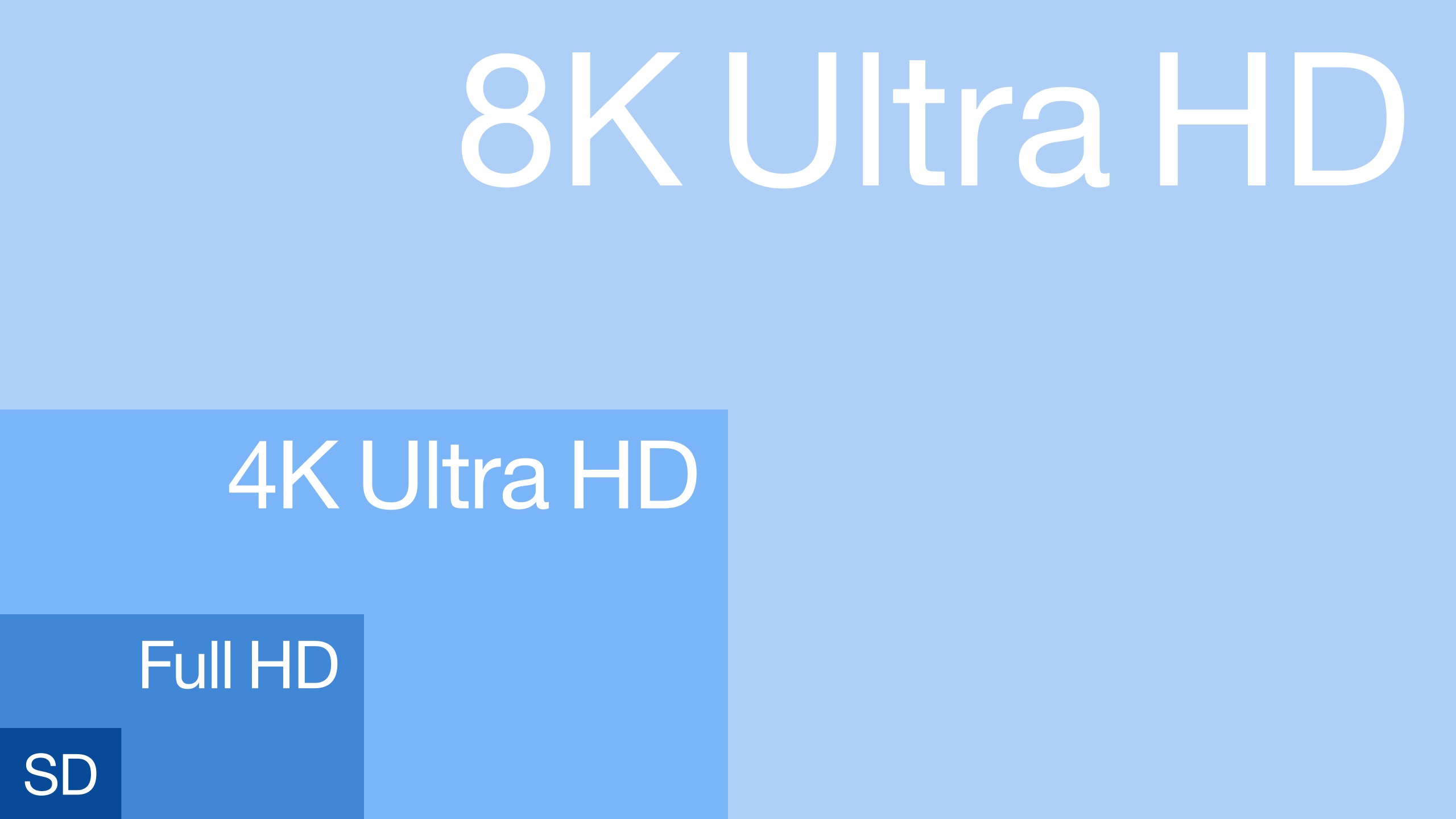

La prima Ultra HD TV 4K fu lanciata nel 2013, e fu una rivoluzione. Con una risoluzione 4 volte superiore a quella del Full HD, era capace di mostrare oltre 8 milioni di pixel contro i 2 milioni del 1080p.

Inizialmente, ça va sans dire, i costi erano stratosferici e i contenuti 4K praticamente inesistenti, fatta esclusione per le spettacolari demo dei produttori. Per fortuna, il gap fu colmato dai servizi di streaming Internet come YouTube, Netflix e Amazon Prime Video.

Nel medesimo periodo, anche i proiettori sono saliti sul vagone dei 4K, sebbene non fossero a buon mercato. Per questa ragione, a fianco dei prodotti con risoluzione nativa 4K, ne nascevano tantissimi altri che riuscivano a ottenere un dettaglio d’immagine molto simile ai 4K partendo però da chip di processamento immagini a 1080p. Una delle tecniche usate era il cosiddetto “pixel-shifting.”

In seguito, i prezzi delle TCV 4K sono crollati, rendendole un lusso alla portata di chiunque; i proiettori 4K invece sono rimasti arroccati su somme più importanti.

https://ultraexperience.it/blog/home-theater-streaming-dvd-o-blu-ray-hd-4k/

Il Miracolo OLED

Le prime TV 4K erano per lo più basate su tecnologia LCD, ma sin dal 2008 si era affacciata sul mercato una tecnologia alternativa e concorrente, chiamata OLED. Senza entrare troppo nel tecnico, la differenza fondamentale tra i due sistemi è che LCD costa meno ma ha bisogno di un sistema di retroilluminazione che aumenta lo spessore della tv e produce neri slavati; OLED invece illumina nativamente ogni pixel, lasciando spenti quelli non necessari, il che significa che:

- Non ha bisogno di retroilluminazione (dunque le TV sono più sottili)

- Produce neri convincenti

- Consuma pure meno (purché non vengano visualizzate immagini molto chiare a tutto schermo; in quel caso, vince LCD)

Sempre nel 2013 furono lanciate le prime HDTV OLED da 55″ prodotte da Samsung e LG, ed è anche quello il momento in cui si sono iniziati a vedere i primi schermi curvi da 10-20.000€ e passa. Nel 2015 fu la volta delle TV 4K baste su OLED, e la differenza qualitativa fu subito sotto gli occhi di tutti.

Un ulteriore miglioramento si è visto con l’introduzione dell’HDR (High Dynamic Range) nel 2016, oggi disponibile sui servizi di streaming online e sui lettori Blu-ray 4K Ultra HD; quando il televisore lo supporta e il video è in 4K HDR, i livelli di contrasto e la qualità dei colori risultano superiori perfino a quelli del cinema. Ad oggi, infatti, non esistono sale dotate di HDR.

Dolby Atmos

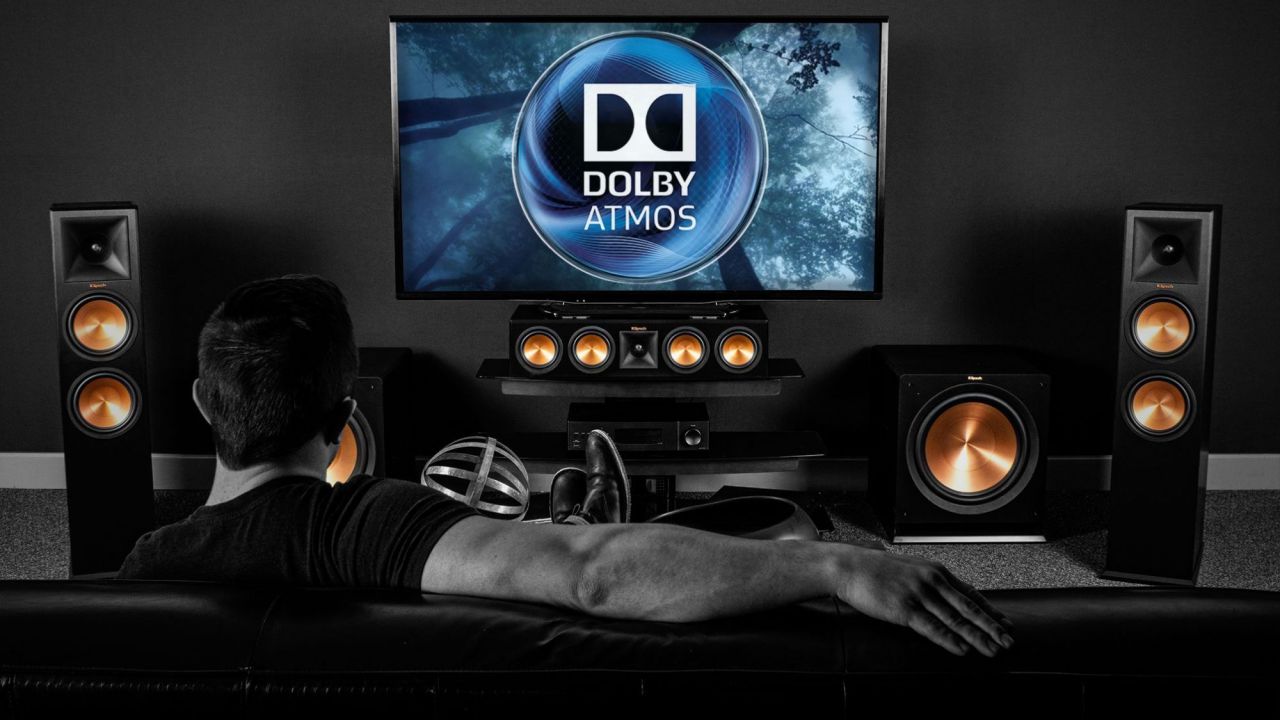

Mentre il video faceva passi da gigante, l’audio non stava a guardare. Nel 2014 infatti fu introdotto Dolby Atmos, seguito dal formato DTS:X l’anno successivo.

Si tratta di una tecnologia capace di legare il suono ai vari oggetti che compaiono nel video, e di spostarli a 360 gradi attorno all’utente. Ciò consente di simulare il frastuono di un elicottero mentre si solleva da terra, oppure il fragore di fulmine che dall’angolo in alto a sinistra sull’angolo destro del pavimento.

Per ottenere lo scopo, ovviamente, servono delle casse posizionate sopra e sotto il punto di vista dell’utente, e contenuti compatibili. Se ne trovano diversi su Netflix e Amazon Prime Video, oltreché su Blu-Ray.

Home Theatre: Il Futuro è degli 8K

Le prime TV 8K -dette anche a Ultra Alta Definizione o UHDTV- hanno fatto capolino nel 2018, e consentono di ammirare contenuti all’incredibile risoluzione di 7.680×4.320 pixel (per un totale di circa 33 megapixel). Ciò significa che un singolo fotogramma UHDTV contiene 16 volte il numero di pixel dell’omologo full HD.

Per il momento, i prezzi di queste tv restano elevati, e i contenuti 8K introvabili. Ma se ci pensate, è lo stesso identico copione che si è ripetuto ad ogni passaggio evolutivo. Dunque è praticamente certo che, nei prossimi anni, l’affinamento dei processi produttivi e il generale abbassamento dei costi per il pubblico porteranno ad una maggiore diffusione di questa tecnologia, che a sua volta convincerà i produttori di contenuti a sfornare video in 8K nativi. E il ciclo si ripeterà di nuovo, solo che la prossima volta arriveranno -chissà quando- i 16K.

Per poter inviare flussi video ad alta risoluzione e audio multicanale a TV, proiettori, lettori ottici, set-top box e così via, si ricorre al cavo HDMI. Lo standard HDMI è completamente digitale, ed è stato introdotto nel 2002 per veicolare le immagini e i suoni dal DVD; poi però, nel corso del tempo, le sue feature sono state aggiornate per soddisfare le esigenze dei nuovi formati audio video. L’ultima versione, HDMI 2.1, è progetta dalle fondamenta per gli 8K.

Sei curioso di scoprire quali innovazioni ci riserverà il futuro nell’ambito del Home Cinema? Rimani ‘connesso’ con Ultra Experience. Con la nostra esperienza e competenza, ti guideremo nel realizzare la sala Home Cinema dei tuoi sogni.